كيف يتعرّف الذكاء الاصطناعي على بصمة الوجه؟

مالك يونس

يقول الله في كتابه المجيد “إِنَّا خَلَقْنَا الْإِنسَانَ مِن نُّطْفَةٍ أَمْشَاجٍ نَّبْتَلِيهِ فَجَعَلْنَاهُ سَمِيعًا بَصِيرًا”.

من أسمى ما ميز الله به خلق الإنسان هو أن يصبح ذا سمع وبصيرة يمكنّه من فهم وإدراك ما يجري حوله من أحداث ليصل به إلى الكمال اللا متناهي بعد السير في عالم مبني على التعلم باستعمال كافة الحواس، وأهمها السمع والبصر.

فالسمع والبصر هما من أهم حواس التواصل مع هذا العالم. يرسلان الأحاسيس إلى منطقة السمع والبصر في الدماغ ليقوم بتحليل هذه المعطيات، فكلما نمت هذه المناطق في الدماغ وازدادت معرفتها أصبح الإنسان أبصر فأبصر وصولًا إلى البصيرة والتفاعل مع أبعاد كل هذا العالم المادي والمعنوي.

فبداية مفهوم الذكاء أو البصيرة هي فهم الصور والأصوات، تمامًا كمرحلة الطفولة. إن إدراك الطفل لوالديه والتفاعل مع أصواتهما هي بداية علامات الذكاء الذي يمكنه من التفاعل مع محيطه. والمرحلة التي وصل إليها الذكاء الاصطناعي اليوم في تشخيص الصور هي نفسها مرحلة الذكاء التي يصل إليها الأطفال من فهم وإدراك للصور والأصوات مع عدم إمكانية ربطها بأحداث من الماضي أو المستقبل.

إن قدرة الذكاء الاصطناعي اليوم في هذا المجال هي أشبه بأبسط أنواع الذكاء الذي يمتلكه أغلب الحيوانات من تعلم وتعرف إلى صور أعدائهم أو أصدقائهم وتحليل أصواتهم لتصنيفهم إلى أصدقاء أو أعداء.

الفارق بين الذكاء الاصطناعي التشخيصي اليوم والذكاء الحيواني هو فقط الذاكرة الأكبر (القرص صلب) التي تمتلكها الأجهزة ما يتيح لها حفظ أشكال متعددة ونغمات صوتية بأحجام كبيرة جداً.

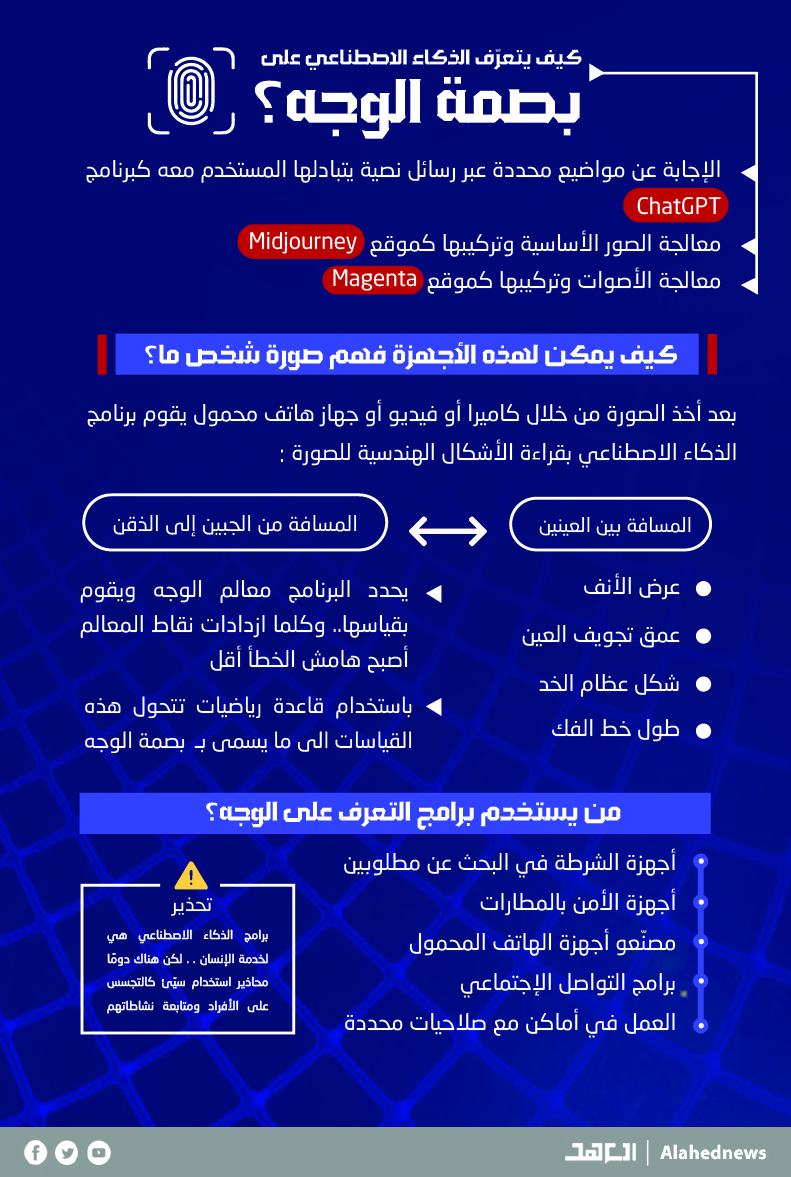

أبرز الخدمات التي تقدمها أجهزة الذكاء الاصطناعي اليوم هي:

• الإجابة عن مواضيع محددة عبر رسائل نصية يتبادلها المستخدم معه كبرنامج ChatGPT

• معالجة الصور الأساسية وتركيبها كموقع Midjourney

• معالجة الأصوات وتركيبها كموقع Magenta

ولكن، كيف يمكن لهذه الأجهزة فهم صورة شخص ما؟

بعد أخذ الصورة من خلال كاميرا أو فيديو أو جهاز هاتف محمول يقوم برنامج الذكاء الاصطناعي بقراءة الأشكال الهندسية للصورة:

• المسافة بين العينين

• المسافة من الجبين إلى الذقن

• عرض الأنف

• عمق تجويف العين

• شكل عظام الخد

• طول خط الفك

يحدد البرنامج معالم الوجه ويقوم بقياسها، وكلما ازدادات نقاط المعالم أصبح هامش الخطأ أقل. وباستخدام قاعدة رياضيات تتحول هذه القياسات الى ما يسمى بـ”بصمة الوجه”. تُسجل هذه البصمة في قاعدة بيانات تحوي بصمات كافة الأشخاص. وللبحث عن شخص ما تقوم هذه البرامج بمقارنة هذه البصمة المأخوذة مع كافة البصمات المحفوظة في قاعدة البيانات.

عام 2018 قالت الشرطة الأمريكية إن لديها 117 مليون بصمة وصورة لشخص أمريكي في قاعدة بيانات الشرطة وأنها قامت بـ 412 مليون عملية بحث عن صور وجه.[1]

درجة الخطأ في التشخيص البشري:

اليوم في ظل تطور العدسات ودقتها وفي ظروف خالية من ضعف في الصورة تستطيع أن تبلغ الدقة حوالي 99.9% مع هامش للخطأ فقط 0.1%. أما إن كانت الصورة المأخوذة في مكان عام مع ضعف في الصورة فيبلغ الخطأ 10% ولكن اليوم يوجد برامج تصحيح للصورة والألوان ما قد يحل بعضًا هذه المشاكل.

أما المشكلة الأهم فهي التقدم في العمر الذي يسبب تغيّرًا في معالم الوجه بنسبة خطأ 10%.

من يستخدم برامج التعرف على الوجه؟

• أجهزة الشرطة في البحث عن مطلوبين.

• أجهزة الأمن بالمطارات.

• مصنّعو أجهزة الهاتف المحمول.

• برامج التواصل الاجتماعي.

• العمل في أماكن مع صلاحيات محددة.

إن برامج الذكاء الإصطناعي هي لخدمة الإنسان مع ازدياد متطلباته واحتياجاته، لكن هناك دومًا محاذير استخدام سيّئ كـالتجسس على الأفراد ومتابعة نشاطاتهم لسهولة التعرف إليهم. ولتجنّب التعرض للتجسس، يجب الابتعاد عن وضع صورنا بتناول أجهزة الذكاء الاصطناعي كبرامج التواصل الاجتماعي التي باتت تحوي كافة صورنا في كافة مراحل أعمارنا ومختلف نشاطاتنا ما يتيح لها التعرف علينا من دون الحاجة حتى لصورة الوجه من خلال خصائص عديدة أصبحت لديها كطول القامة أو حجم الكتف وغيرها.

رغم تطوّرها وتميّزها، إلا أن هذه الأجهزة الاصطناعية لا يمكن لها أن تحل مكان الإنسان لأنها لا زالت في طور بداية التعرف على الموجودات، ولا يمكن لها يومًا ما أن تحمل المشاعر، أو الأحاسيس والبصيرة لقراءة الماضي والحاضر والمستقبل.

https://us.norton.com/blog/iot/how-facial-recognition-software-works [1]

الولاية الاخبارية موقع اخباري وثقافي لمن يسلك الطريق الی الله

الولاية الاخبارية موقع اخباري وثقافي لمن يسلك الطريق الی الله